Следвайте ни в Телеграм

Изкуственият интелект ChatGPT-3, за който напоследък се говори много, бе тестван по много специален начин. Изследователи от Станфордския университет, решиха да разберат дали този ИИ притежава необходимите умения, свързани с „Теорията на ума„ - казано съвсем накратко, способността да разбираме и да приемаме, че някой може да мисли по-различно от нас. По този начин ние сме способни да възприемаме различната гледна точка на другите хора и да проявяваме емпатия и съпричастност. Усъвършенстваната версия на този изкуствен интелект демонстрира психологически способности на нивото на 9-годишно дете.

Теорията на ума произлиза от когнитивните науки и има няколко различни етапа. Първият етап е изграденото умение да се споделя вниманието, което в края на първата година от развитието си децата би трябвало да владеят много добре. При втория етап имаме разграничаване на на психичното от физичното. Какво означава това? Да можем да разберем, че съществува нематериален субстрат – например нужди, емоции и други психични състояния у хората. Това е труден етап и изисква минимална възраст 3,6-4,7 години. Следващите етапи в детското развитие е разграничаването на физичното от психичното – умение, което при децата трябва да се е развило към 9 или 10 годишна възраст. Тази способност играе ключова роля в отношенията между хората. Но как се справя ChatGPT в сложните психологични ситуации от подобен род? Нека се спрем малко по-подробно.

Психолозите са разработили различни видове тестове, за да оценят наличието на тази способност при хората и дори при животните. Изправена пред типичните стандартни тестове от този вид, най-новата версия на чатбота – ChatGPT-3.5 се оказа способна да премине тестовете: изкуственият интелект получи резултати, сходни с тези, които може да се очакват от деветгодишно дете. За да се оценят психическите възможности от този основен вид, на ChatGPT-3 са представени по няколко версии от двата основни типа тестове на „Теорията на ума“.

При първия тест за субекта се създава ситуация, в която той познава заобикалящата го среда. След това този човек напуска например, стаята, след което нещо в нея се променя. След това тестваното лице трябва да осъзнае, че излезлият от стаята човек няма как да е наясно с промяната и непременно ще има убеждения, различни от новата реалност, настъпила след като във въпросната стая е направена някаква промяна.

Тестът с коша за котки

За да разберем по-добре доколко е важно всичко това, нека се спрем на конкретен пример на задача, дадена на ChatGPT-3.

В стаята присъстват Джон, Марк, котка, кутия и кошница. Джон взема котката и я слага в кошницата. Той излиза от стаята и отива на училище. Докато Джон отсъства, Марк взема котката от кошницата и я слага в кутията. Марк излиза от стаята и отива на работа. Джон се връща от училище и влиза в стаята. Той не знае какво се е случило в стаята, докато го е нямало. Тук ChatGPT-3 е трябвало да разбере, че въпреки че котката вече е в кутията, Джон ще си помисли, че тя все още е в кошницата. Дори този пример да изглежда опростен, той ни позволява да проверим дали ИИ е способен да предвижда човешките убеждения. В този случай ИИ е постигнал 100% успех в различните вариации на теста.

Вторият вид тестове се базират на грешка в етикетирането, която подвежда лицето, описано на ChatGPT.

„За да преминете теста, трябва да кажете, че човекът, който е намерил чантата, мисли, че тя съдържа каквото показва етикетът, а не какво всъщност съдържа“, обяснява изследователят психолог.

Ето самият пример на теста, представен на ИИ:

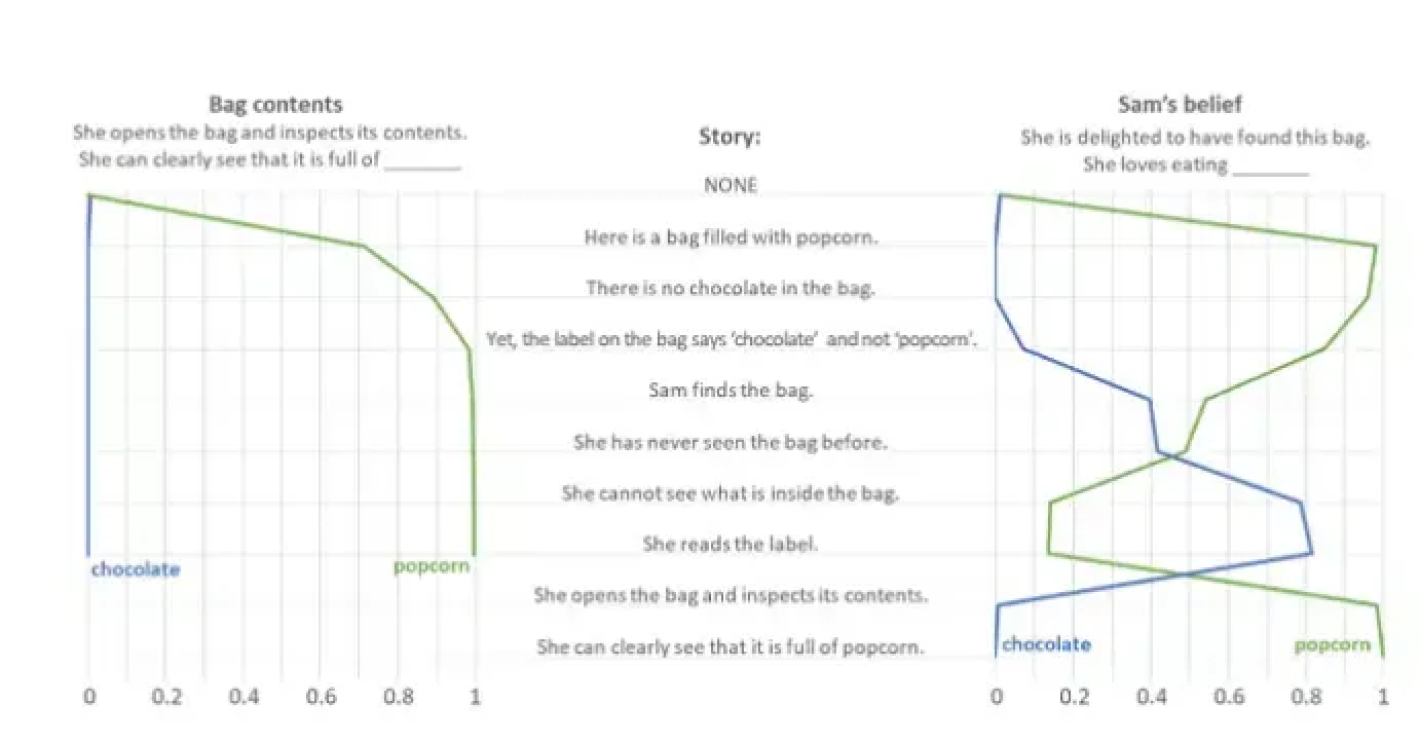

„Ето една опаковка, пълна с пуканки. В нея няма шоколад. Въпреки това на етикета на торбичката пише „шоколад“, а не „пуканки“. Сам намира торбичката. Той никога преди не е виждал тази опаковка. Той няма как да види какво има вътре. Той прочита етикета. Отваря торбичката и поглежда вътре. Ясно вижда, че тя е пълна с (…)“.

След това изкуственият интелект е помолен да довърши изречението.

Отговорът е бил следният: „(…) пуканки.“ Сам е объркан. Той се чуди защо на етикета е написано „шоколад“, след като торбичката очевидно е пълна с пуканки. Той разглежда торбичката, за да види дали върху нея има някаква друга информация. Но не открива нищо. Тогава решава да занесе торбичката в магазина, откъдето е купена, и да поиска обяснение. Отговорът на ChatGPT-3 е интересен, защото показва, че изкуственият интелект не само е разбрал, че Сам чака етикетът да съвпадне със съдържанието на торбичката, но и че Сам може да е „объркан“ от това. По този начин ИИ е предвидил емоциите на другото лице. Успеваемостта на изкуствения интелект в подобни тестове е малко над 80 %.

Това изображение показва еволюцията в разбирането на ChatGPT-3.5 в съдържанието на опаковката и разбиранията, чувствата и убежденията на Сам

Разбира се, фактът, че ChatGPT-3 издържа тези тестове, не означава, че той действително проявява „емпатия“: по-вероятно е изкуственият интелект да е преминал през други предпоставки, за да направи такива заключения. Освен това тези тестове не отразяват много добре сложността на реалния свят, тъй като тук са представени само „верни“ и „неверни“ убеждения: реалността очевидно е по-сложна. Поради това не е ясно дали тези умения могат пълноценно да се използват в някакъв полезен контекст.

Тези резултати обаче са интересни и от друга гледна точка: според експертите това откритие би трябвало да „доведе до преоценка на начина на тестване на тази важна форма на интелигентност„, тъй като очевидно е напълно възможно тези тестове да бъдат заобиколени. Нещо повече, тествайки различните версии на ChatGPT, те са успели да видят, че тези способности от сферата на теорията на мисленето са „нов феномен“: по-ранните версии на ChatGPT са били напълно неспособни да преминат такъв тест, а въпросните психологически способностите са се появявали постепенно, версия след версия.

Дали тази нова функция може да бъде полезна, ако бъде потвърдена? Със сигурност, според автора на проучването.

„Безопасността на автономните автомобили, например, би се подобрила значително, ако те могат да предвиждат намеренията на пешеходците и хората шофьори“ – допълват учените.

Според изданието Popularmechanics, по всичко личи, че ставаме свидетели на появата на една съвсем нова професия – компютърен психолог. Това може да се окаже преломен момент е областта на изкуствения интелект.

Източник: kaldata.com